Apprendre à désapprendre, un défi pour l'IA

Quand Brian Hood a découvert que ChatGPT lui attribuait un passé criminel, ce politicien australien s'est retrouvé face à un casse-tête que des ingénieurs tentent désormais de résoudre: comment apprendre à l'intelligence artificielle (IA) à effacer des erreurs ?

Ni la solution légale — en avril, Brian Hood a menacé de porter plainte pour diffamation contre la société OpenAI, à l'origine de ChatGPT — ni le reparamétrage complet des IA ne semble une solution satisfaisante: entraîner à nouveau le modèle s'avérerait particulièrement long et coûteux.

Or, les spécialistes considèrent que le problème du désapprentissage de l'IA sera crucial dans les prochaines années, au regard notamment de la règlementation européenne sur la protection des données (RGPD).

"La capacité à effacer des données au sein de bases d'apprentissage est un sujet majeur", confirme Lisa Given, professeur en sciences de l'information à l'université RMIT de Melbourne. Mais au regard du manque actuel de connaissances sur le fonctionnement des IA, le chemin est encore long, selon elle.

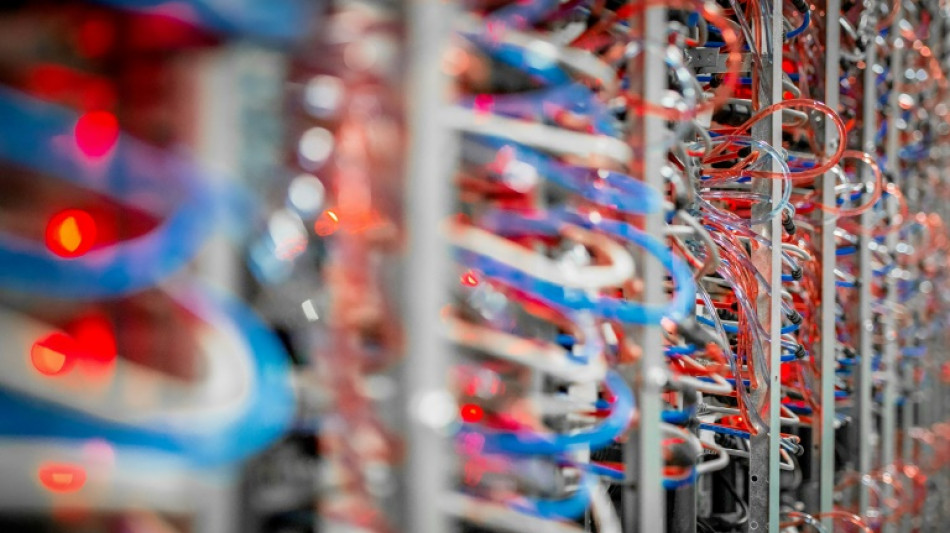

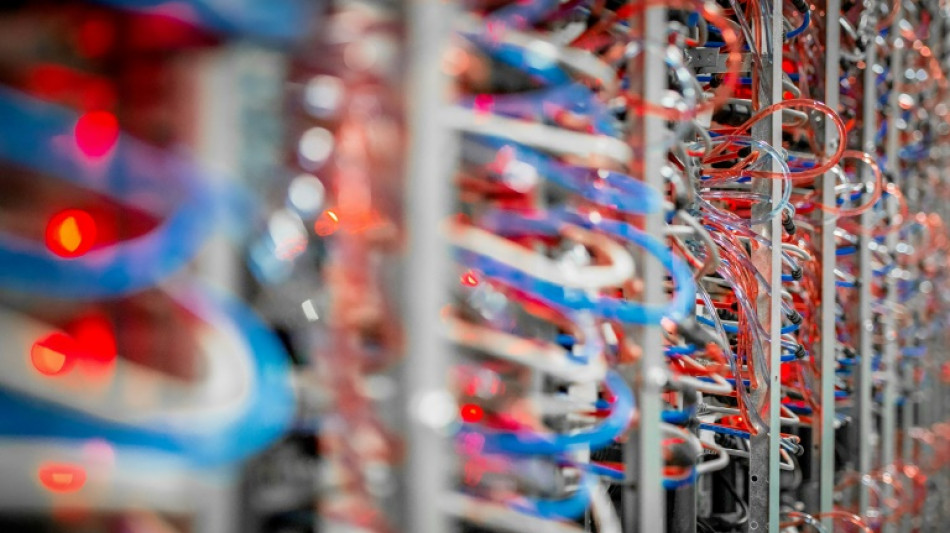

Devant la somme colossale de données sur lesquelles les IA sont entraînées, les ingénieurs cherchent plutôt une solution ciblée afin d'écarter des informations fausses de leur champ de connaissance et d'en arrêter la propagation.

Le sujet a pris de l'ampleur depuis trois à quatre ans, a confirmé à l'AFP le chercheur Meghdad Kurmanji, de l'université britannique de Warwick, expert du domaine.

Google DeepMind, spécialisée dans l'IA, s'est emparée du problème: des experts de la firme américaine ont publié le mois dernier, avec M. Kurmanji, un algorithme destiné à effacer des données au sein d'importants modèles de langage, comme ceux de ChatGPT ou de Bard, le modèle de Google.

- Correction de certains biais -

Et, entre juillet et septembre, plus de 1.000 participants se sont attelés à peaufiner des méthodes de "désapprentissage" des IA dans le cadre d'un concours lancé par l'entreprise américaine.

La méthode employée, commune aux autres recherches en la matière, consiste à introduire un algorithme ordonnant à l'IA de ne pas tenir compte de certaines informations apprises et n'implique pas de modifier la base de données.

Meghdad Kurmanji assure que ce procédé peut être "un outil très intéressant" pour permettre, par exemple, à des outils de recherche de répondre à des demandes de suppression, en conformité avec la protection des données personnelles.

L'algorithme mis au point s'est également montré performant dans la suppression de contenus protégés par des droits d'auteur ou dans la correction de certains biais, assure-t-il.

D'autres, comme le responsable de l'IA au sein de Meta (Facebook, Instagram) Yann LeCun, se montrent plus réticents.

"Je ne dis pas que c'est inutile, sans intérêt ou mauvais, mais je pense qu'il y a d'autres priorités", affirme-t-il à propos de cet algorithme auprès de l'AFP.

Pour Michael Rovatsos, professeur en intelligence artificielle à l'université d'Édimbourg, "la solution technique n'est pas la panacée".

Le "désapprentissage" ne permettrait pas, selon lui, de poser des questions plus larges, comme celle de savoir comment les données sont rassemblées, qui en tire profit ou encore à qui doit incomber la responsabilité des dommages engendrés par l'IA.

Si Brian Hood a vu son problème réglé, sans explication, une fois que son affaire a été suffisamment médiatisée pour corriger automatiquement les données traitées par ChatGPT (qui n'a pas répondu aux sollicitations de l'AFP), il considère que l'heure est encore aux méthodes artisanales.

"Il faut que les utilisateurs vérifient tout, dans les cas où les chatbots écrivent des âneries", affirme l'Australien.

(A.Johnson--TAG)

Paris

Paris

Lyon

Lyon

Lille

Lille

Monaco

Monaco

Bordeaux

Bordeaux

Luxembourg

Luxembourg

Marseille

Marseille

Brussels

Brussels

Guernsey

Guernsey

Jersey

Jersey

Burkina Faso

Burkina Faso

Guinea

Guinea

Mali

Mali